Cara Menjalankan LLM di Laptop Tanpa Internet menggunakan Ollama

Cara Menjalankan LLM di Laptop Tanpa Internet menggunakan Ollama

Menjalankan LLM di Laptop Tanpa Internet menggunakan Ollama

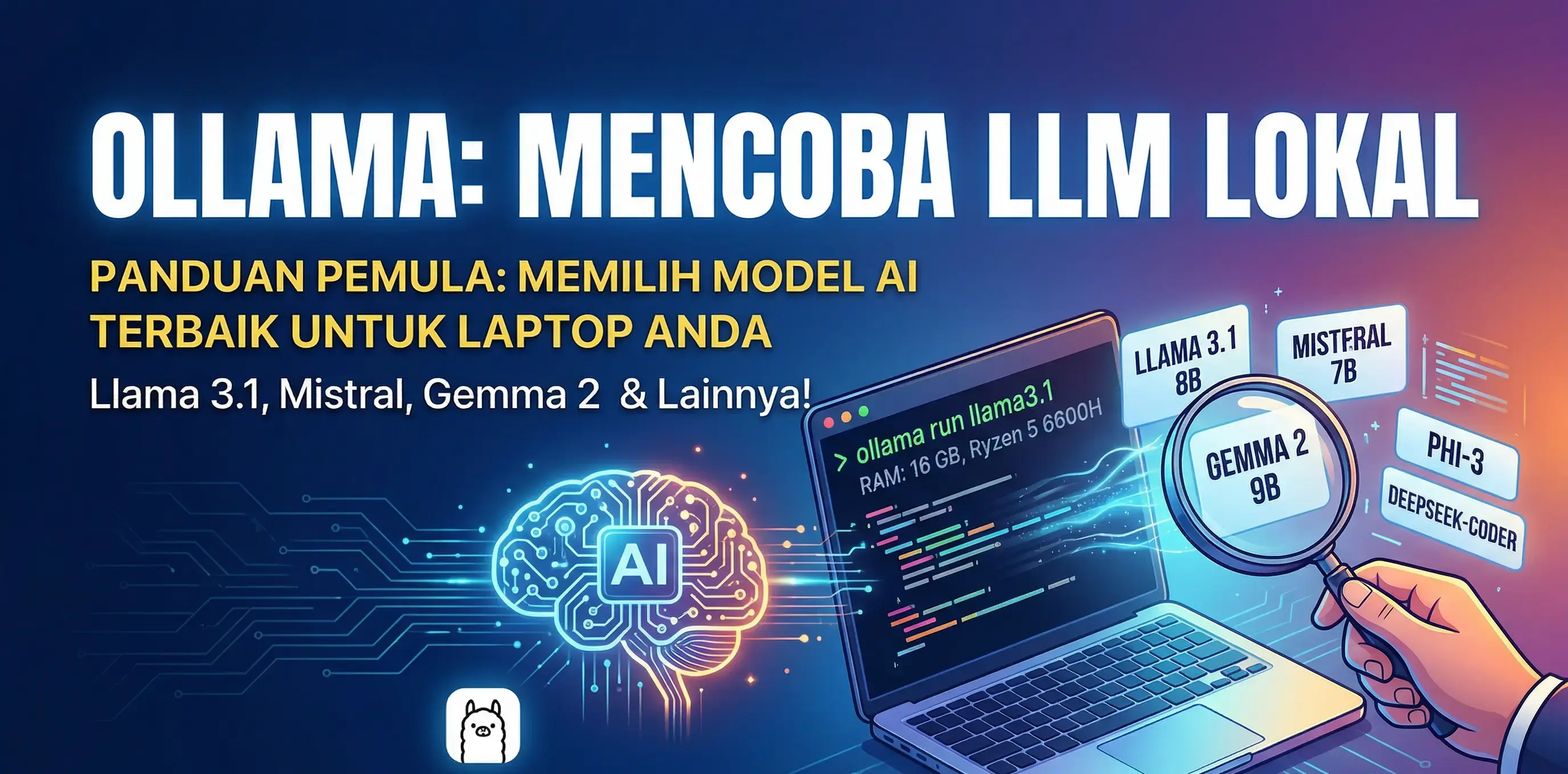

Menjalankan LLM di laptop menggunakan Ollama adalah salah satu cara yang bisa digunakan untuk mengakses dan menggunakan LLM secara bebas di laptop. Dengan menggunakan Ollama, sobat nalar bisa menjalankan model LLM tanpa takut terkena limit dari penyedia model. Contohnya ketika menggunakan model Sonnet 4.6 melalui platform claude AI, ketika penggunaan model sudah mencapai batas maka teman teman diwajibkan untuk melalukan upgrade ke premium agar dapat mengakses model tersebut. Dengan Ollama, tidak ada batasan mengenai model model. Segala bentuk eksperimen dapat dilakukan tanpa takut terkena limit.

Apa itu LLM (Large Language Model)?

LLM atau singkatan dari Large Language Model adalah sebuah model yang telah dilatih menggunakan data yang sangat banyak. LLM memiliki banyak kegunaan seperti dapat memahami, memprediksi, merangkum serta menghasilkan teks. Mengikuti perkembangan zaman, LLM telah berevolusi dan digunakan untuk berbagai keperluan seperti membantu engineer untuk menulis kode program, penerjemahan bahasa, chatbot asisten virtual 24 jam dan masih banyak lagi.

Apa itu Ollama?

Ollama adalah sebuah platform yang ciptakan untuk menjalankan model LLM secara lokal atau cloud. Dengan Ollama, pengguna dapat mengakses dan menggunakan model LLM tanpa takut terkena limit atau batasan. Namun yang perlu di perhatikan ketika menggunakan LLM di lokal dengan Ollama adalah spesifikasi laptop yang memadai. Jika spesifikasi laptop yang digunakan kurang memadai, maka hal tersebut dapat memicu crash atau lag untuk laptop pengguna.

Mengapa menjalankan LLM menggunakan Ollama?

Ollama merupakan tools atau platform open source yang memungkinkan pengguna untuk mengakses dan menjalankan LLM secara lokal atau cloud. Beberapa keunggulan dari Ollama adalah open source, privasi data terjaga atau aman, mudah digunakan, dan gratis tanpa biaya API.

Persiapan Sebelum Menjalankan LLM menggunakan Ollama

Install Ollama

Untuk menjalankan LLM menggunakan Ollama maka sobat nalar perlu menginstall Ollama terlebih dahulu, Silahkan kunjungi website Download Ollama atau ikuti cara dibawah ini.

- Mac/Linux

curl -fsSL https://ollama.com/install.sh | sh

- Windows

irm https://ollama.com/install.ps1 | iex

Download Model LLM

Setelah menginstall Ollama, sobat nalar juga perlu mengunduh model LLM yang akan digunakan. Masuk ke terminal atau CMD kemudian ketikkan perintah dibawah ini.

ollama run llama3.1

Maka akan terjadi proses pulling model atau download model.

Tata Cara Menjalankan LLM menggunakan Ollama

Menjalankan LLM Melalui Command Prompt

Untuk menggunakan model yang telah di pull atau di download, silahkan gunakan perintah dibawah ini.

ollama run llama3.1

Coba gunakan model dengan menanyakan beberapa pertanyaan.

Testing model di Command Prompt

Testing model di Command Prompt

Menjalankan LLM Melalui Ollama Studio

Terdapat salah satu opsi juga jika ingin menjalankan model melalui platform Ollama langsung. Perbedaan ketika menggunakan terminal dan platform Ollama langsung adalah bentuk antarmukanya. Platform Ollama menawarkan antarmuka yang lebih mudah dipahami namun untuk terminal memiliki lebih banyak fleksibilitas penggunaan.

Testing model di Ollama

Testing model di Ollama

Tips dan Trik penggunaan Ollama

- Ketikkan perintah ollama di Command Prompt untuk melihat menu menu yang disediakan

- Ketikkan perintah ollama launch openclaw untuk menjalankan OpenClaw.

- Ketikkan perintah ollama launch claude untuk menjalankan Claude.

Read Next

View all articlesCara Membuat Chatbot Telegram dengan n8n & LM Studio (AI Lokal Tanpa Coding)

Panduan step-by-step membuat chatbot Telegram menggunakan n8n dan LM Studio sebagai AI lokal tanpa coding. Cocok untuk self-hosted AI bot, automation workflow, dan penelitian AI offline di PC atau server lokal.

Tutorial Lengkap Membuat Chatbot Telegram dengan n8n dan Gemini AI Tanpa Coding

Panduan lengkap membuat chatbot Telegram dengan n8n dan model Gemini AI

Cara Menjalankan LLM di Windows Tanpa Internet Menggunakan LM Studio

Panduan lengkap menjalankan Large Language Model di laptop tanpa koneksi internet. Hemat biaya, privasi terjaga, dan tetap produktif!